I would like to tell you a story

Eu gostaria de contar-lhes uma história

connecting the notorious privacy incident

que conecta o famoso incidente de privacidade

involving Adam and Eve,

envolvendo Adão e Eva,

and the remarkable shift in the boundaries

e a notável mudança no limite

between public and private which has occurred

entre o público e o privado que vem acontecendo

in the past 10 years.

nos últimos 10 anos.

You know the incident.

Vocês conhecem o incidente.

Adam and Eve one day in the Garden of Eden

Adão e Eva, um dia, no Jardim do Éden,

realize they are naked.

se dão conta de que estão nus.

They freak out.

Eles se apavoram.

And the rest is history.

E o resto vocês já conhecem.

Nowadays, Adam and Eve

Hoje em dia, Adão e Eva

would probably act differently.

provavelmente reagiriam diferente.

[@Adam Last nite was a blast! loved dat apple LOL]

[@Adão Ontem à noite foi show! Curti akela maçã LOL]

[@Eve yep.. babe, know what happened to my pants tho?]

[@Eva pois é... gata, cê viu minha calça por aí?]

We do reveal so much more information

Nós publicamos muito mais informações

about ourselves online than ever before,

sobre nós mesmos on-line do que jamais antes,

and so much information about us

e tanta informação sobre nós

is being collected by organizations now.

está sendo coletada por organizações agora.

There is much to gain and benefit

Há muito a se ganhar e a se beneficiar

from this massive analysis of personal information,

dessa análise massiva de informações pessoais,

or big data,

ou big data,

but there are also complex tradeoffs that come

mas há também desvantagens complexas

from giving away our privacy.

ao abrir mão da privacidade.

And my story is about these tradeoffs.

E minha história é sobre essas desvantagens.

We start with an observation which, in my mind,

Começamos com uma observação que, na minha mente,

has become clearer and clearer in the past few years,

se tornou cada vez mais clara nos últimos anos,

that any personal information

de que qualquer informação pessoal

can become sensitive information.

pode se tornar delicada.

Back in the year 2000, about 100 billion photos

No ano de 2000, cerca de 100 bilhões de fotos

were shot worldwide,

foram tiradas em todo o mundo,

but only a minuscule proportion of them

mas somente uma porção minúscula delas

were actually uploaded online.

acabou sendo carregada na Internet.

In 2010, only on Facebook, in a single month,

Em 2010, somente no Facebook, em um único mês,

2.5 billion photos were uploaded,

2,5 bilhões de fotos foram carregadas,

most of them identified.

a maioria identificada.

In the same span of time,

No mesmo período de tempo,

computers' ability to recognize people in photos

a capacidade dos computadores de reconhecerem pessoas em fotos

improved by three orders of magnitude.

melhorou em três ordens de grandeza.

What happens when you combine

O que acontece quando colocamos

these technologies together:

essas tecnologias juntas:

increasing availability of facial data;

crescente disponibilidade de informações faciais;

improving facial recognizing ability by computers;

crescente capacidade de reconhecimento facial por computadores;

but also cloud computing,

mas também computação em nuvem,

which gives anyone in this theater

que oferece a qualquer um neste salão

the kind of computational power

o tipo de poder computacional

which a few years ago was only the domain

que há alguns anos era somente o domínio

of three-letter agencies;

de agências de três letras;

and ubiquitous computing,

e computação ubíqua,

which allows my phone, which is not a supercomputer,

que permite que meu celular, que não é um supercomputador,

to connect to the Internet

conecte-se à Internet

and do there hundreds of thousands

e faça lá centenas de milhares

of face metrics in a few seconds?

de correspondências faciais em alguns segundos?

Well, we conjecture that the result

Bem, nós conjecturamos que o resultado

of this combination of technologies

dessa combinação de tecnologias

will be a radical change in our very notions

será uma mudança radical em nossas noções

of privacy and anonymity.

de privacidade e anonimato.

To test that, we did an experiment

Para testar isso, fizemos um experimento

on Carnegie Mellon University campus.

no campus da universidade de Carnegie Mellon.

We asked students who were walking by

Nós pedimos a estudantes que estavam passando

to participate in a study,

para participarem em um estudo,

and we took a shot with a webcam,

e tiramos uma foto com uma webcam,

and we asked them to fill out a survey on a laptop.

e pedimos que eles preenchessem uma pesquisa em um laptop.

While they were filling out the survey,

Enquanto estavam preenchendo a pesquisa,

we uploaded their shot to a cloud-computing cluster,

nós enviamos a foto para um cluster de computação em nuvem,

and we started using a facial recognizer

e começamos a usar um reconhecedor facial

to match that shot to a database

para equiparar aquela foto com um banco de dados

of some hundreds of thousands of images

de algumas centenas de milhares de fotos

which we had downloaded from Facebook profiles.

que tínhamos baixado de perfis do Facebook.

By the time the subject reached the last page

No momento que o participante atingia a última página

on the survey, the page had been dynamically updated

na pesquisa, a página tinha sido atualizada dinamicamente

with the 10 best matching photos

com as 10 fotos que melhor se ajustavam

which the recognizer had found,

e que o reconhecedor tinha encontrado,

and we asked the subjects to indicate

e pedimos que os participantes indicassem

whether he or she found themselves in the photo.

se eles estavam ou não na foto.

Do you see the subject?

Você vê o participante?

Well, the computer did, and in fact did so

Bem, o computador viu e, de fato, viu

for one out of three subjects.

para um em cada três participantes.

So essentially, we can start from an anonymous face,

Então essencialmente, podemos partir de um rosto anônimo,

offline or online, and we can use facial recognition

off-line ou on-line, e podemos usar reconhecimento facial

to give a name to that anonymous face

para dar um nome a um rosto anônimo,

thanks to social media data.

graças a dados de mídia social.

But a few years back, we did something else.

Mas há alguns anos, nós fizemos algo diferente.

We started from social media data,

Nós partimos de dados de mídia social,

we combined it statistically with data

combinamos estatisticamente com dados

from U.S. government social security,

da seguridade social do governo americano,

and we ended up predicting social security numbers,

e acabamos prevendo números de seguridade social,

which in the United States

que nos Estados Unidos

are extremely sensitive information.

são informações extremamente delicadas.

Do you see where I'm going with this?

Vocês veem onde estou indo com isso?

So if you combine the two studies together,

Então, se combinarmos os dois estudos,

then the question becomes,

a questão se torna:

can you start from a face and,

dá para partir de um rosto e,

using facial recognition, find a name

usando reconhecimento facial, encontrar um nome

and publicly available information

e informação disponível publicamente

about that name and that person,

sobre esse nome e essa pessoa,

and from that publicly available information

e dessa informação publicamente disponível

infer non-publicly available information,

inferir informação indisponível publicamente,

much more sensitive ones

muito mais delicada,

which you link back to the face?

que podemos conectar de volta com o rosto?

And the answer is, yes, we can, and we did.

E a resposta é, sim, dá para fazer, e nós fizemos.

Of course, the accuracy keeps getting worse.

Claro, a precisão continua caindo.

[27% of subjects' first 5 SSN digits identified (with 4 attempts)]

[27% dos cinco primeiros dígitos do SSN do indivíduo identificados (em 4 tentativas)]

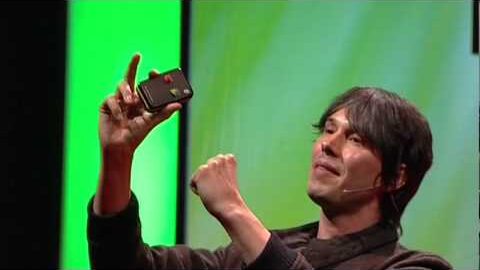

But in fact, we even decided to develop an iPhone app

Mas na verdade, nós até decidimos desenvolver um aplicativo para iPhone

which uses the phone's internal camera

que usa a câmera interna do celular

to take a shot of a subject

para tirar a foto de um indivíduo

and then upload it to a cloud

e então envia para a nuvem

and then do what I just described to you in real time:

e faz em tempo real o que acabei de descrever:

looking for a match, finding public information,

faz a correspondência, encontra informação pública,

trying to infer sensitive information,

tenta inferir informação delicada,

and then sending back to the phone

e então envia de volta ao iPhone

so that it is overlaid on the face of the subject,

para que seja sobreposta ao rosto do indivíduo,

an example of augmented reality,

um exemplo de realidade aumentada,

probably a creepy example of augmented reality.

provavelmente um exemplo assustador de realidade aumentada.

In fact, we didn't develop the app to make it available,

Na verdade, não desenvolvemos o aplicativo para disponibilizar,

just as a proof of concept.

somente como prova de conceito.

In fact, take these technologies

De fato, pegue essas tecnologias

and push them to their logical extreme.

e coloque-as até seu extremo lógico.

Imagine a future in which strangers around you

Imagine um futuro onde estranhos à sua volta

will look at you through their Google Glasses

olharão para você por seus Google Glasses

or, one day, their contact lenses,

ou, um dia, suas lentes de contato,

and use seven or eight data points about you

e usar sete ou oito pontos de dados sobre você

to infer anything else

para inferir qualquer outra coisa

which may be known about you.

que se possa saber sobre você.

What will this future without secrets look like?

Como será esse futuro sem segredos?

And should we care?

E deveríamos nos preocupar?

We may like to believe

Nós talvez queiramos acreditar

that the future with so much wealth of data

que o futuro com tanta riqueza de dados

would be a future with no more biases,

será um futuro sem preconceitos,

but in fact, having so much information

mas na verdade, ter tanta informação

doesn't mean that we will make decisions

não quer dizer que tomaremos decisões

which are more objective.

que sejam mais objetivas.

In another experiment, we presented to our subjects

Em outro experimento, nós apresentamos aos participantes

information about a potential job candidate.

informações sobre um potencial candidato de emprego.

We included in this information some references

Incluímos nessas informações algumas referências

to some funny, absolutely legal,

a informações engraçadas, totalmente legais,

but perhaps slightly embarrassing information

mas talvez levemente constrangedoras

that the subject had posted online.

que o participante tinha postado on-line.

Now interestingly, among our subjects,

Agora, curiosamente, entre os participantes,

some had posted comparable information,

alguns tinham postado informações comparáveis,

and some had not.

e outros não.

Which group do you think

Que grupo vocês acham

was more likely to judge harshly our subject?

que estava mais suscetível a julgar severamente nosso participante?

Paradoxically, it was the group

Paradoxalmente, foi o grupo

who had posted similar information,

que tinha postado informação similar,

an example of moral dissonance.

um exemplo de dissonância moral.

Now you may be thinking,

Você podem estar pensando.

this does not apply to me,

isso não se aplica a mim,

because I have nothing to hide.

porque não tenho nada a esconder.

But in fact, privacy is not about

Mas na verdade, privacidade não se trata

having something negative to hide.

de ter algo negativo a esconder.

Imagine that you are the H.R. director

Imagine que você é o diretor de RH

of a certain organization, and you receive résumés,

de uma certa organização, e você recebe currículos,

and you decide to find more information about the candidates.

e decide procurar mais informações sobre os candidatos.

Therefore, you Google their names

Portanto, você pesquisa seus nomes

and in a certain universe,

e em um certo universo,

you find this information.

você encontra esta informação.

Or in a parallel universe, you find this information.

Ou em um universo paralelo, você encontra esta informação.

Do you think that you would be equally likely

Você acha que estaria igualmente disposto

to call either candidate for an interview?

a chamar o candidato para uma entrevista?

If you think so, then you are not

Se você pensa que sim, então você não é

like the U.S. employers who are, in fact,

como os empregadores americanos que, na verdade,

part of our experiment, meaning we did exactly that.

são parte de nosso experimento, ou seja, fizemos exatamente isso.

We created Facebook profiles, manipulating traits,

Criamos perfis no Facebook, manipulando características,

then we started sending out résumés to companies in the U.S.,

e começamos a enviar currículos para empresas nos EUA,

and we detected, we monitored,

e detectamos, monitoramos,

whether they were searching for our candidates,

se estavam procurando pelos nossos candidatos,

and whether they were acting on the information

e se estavam reagindo às informações

they found on social media. And they were.

que encontravam na mídia social. E estavam.

Discrimination was happening through social media

Discriminação estava acontecendo pela mídia social

for equally skilled candidates.

para candidatos igualmente capazes.

Now marketers like us to believe

Marqueteiros gostam que acreditemos

that all information about us will always

que toda informação sobre nós sempre será

be used in a manner which is in our favor.

usada de uma maneira a nosso favor.

But think again. Why should that be always the case?

Mas pensem novamente. Por que esse deve ser sempre o caso?

In a movie which came out a few years ago,

Em um filme que saiu há alguns anos,

"Minority Report," a famous scene

"Minority Report", uma cena famosa

had Tom Cruise walk in a mall

tinha Tom Cruise entrando em um shopping

and holographic personalized advertising

e anúncios holográficos personalizados

would appear around him.

apareciam a sua volta.

Now, that movie is set in 2054,

Agora, esse filme acontece em 2054,

about 40 years from now,

cerca de daqui a 40 anos,

and as exciting as that technology looks,

e por mais interessante que pareça essa tecnologia,

it already vastly underestimates

ela já subestima enormemente

the amount of information that organizations

a quantidade de informação que as organizações

can gather about you, and how they can use it

podem juntar sobre você, e como podem usá-la

to influence you in a way that you will not even detect.

para influenciá-lo de uma maneira que você nem perceba.

So as an example, this is another experiment

E como exemplo, este é um outro experimento

actually we are running, not yet completed.

que estamos fazendo, ainda não terminamos.

Imagine that an organization has access

Imagine que uma organização tem acesso

to your list of Facebook friends,

à sua lista de amigos no Facebook,

and through some kind of algorithm

e através de algum tipo de algoritmo

they can detect the two friends that you like the most.

eles conseguem detectar seus dois amigos preferidos.

And then they create, in real time,

E eles criam, em tempo real,

a facial composite of these two friends.

uma composição facial desses dois amigos.

Now studies prior to ours have shown that people

E estudos anteriores ao nosso mostraram que as pessoas

don't recognize any longer even themselves

não reconhecem mais, mesmo se forem elas mesmas

in facial composites, but they react

em composições faciais, mas elas reagem

to those composites in a positive manner.

a essas composições de maneira positiva.

So next time you are looking for a certain product,

Então, da próxima vez que você estiver procurando por um certo produto,

and there is an ad suggesting you to buy it,

e houver um anúncio sugerindo que você o compre,

it will not be just a standard spokesperson.

não será somente um porta-voz em geral.

It will be one of your friends,

Será um de seus amigos,

and you will not even know that this is happening.

e você nem vai saber que isso está acontecendo.

Now the problem is that

E o problema é que

the current policy mechanisms we have

os mecanismos de políticas que temos atualmente

to protect ourselves from the abuses of personal information

para nos proteger dos abusos de informações pessoais

are like bringing a knife to a gunfight.

são como levar uma faca para um tiroteio.

One of these mechanisms is transparency,

Um desses mecanismos é a transparência,

telling people what you are going to do with their data.

dizer às pessoas o que se vai fazer com os dados delas.

And in principle, that's a very good thing.

E, em princípio, isso é uma coisa muito boa.

It's necessary, but it is not sufficient.

É necessário, mas não é suficiente.

Transparency can be misdirected.

A transparência pode ser mal direcionada.

You can tell people what you are going to do,

Você pode dizer às pessoas o que vai fazer,

and then you still nudge them to disclose

e você ainda avisa para revelar

arbitrary amounts of personal information.

quantidades arbitrárias de informações pessoais.

So in yet another experiment, this one with students,

E ainda em outro experimento, este com estudantes,

we asked them to provide information

nós pedimos que eles fornecessem informações

about their campus behavior,

a respeito de seu comportamento no campus,

including pretty sensitive questions, such as this one.

incluindo questões delicadas, como esta.

[Have you ever cheated in an exam?]

[Você já colou em uma prova?]

Now to one group of subjects, we told them,

Agora para um grupo de participantes nós dissemos:

"Only other students will see your answers."

"Somente outros estudantes verão suas respostas."

To another group of subjects, we told them,

Para outro grupo de participantes, nós dissemos:

"Students and faculty will see your answers."

"Estudantes e professores verão suas respostas."

Transparency. Notification. And sure enough, this worked,

Transparência. Notificação. E com certeza, funcionou,

in the sense that the first group of subjects

no sentido de que o primeiro grupo de participantes

were much more likely to disclose than the second.

estava muito mais disposto a se expor do que o segundo.

It makes sense, right?

Faz sentido, certo?

But then we added the misdirection.

Mas aí adicionamos um despiste.

We repeated the experiment with the same two groups,

Nós repetimos o experimento com os mesmos dois grupos,

this time adding a delay

desta vez adicionando uma demora

between the time we told subjects

entre o momento quando dizíamos aos participantes

how we would use their data

como usaríamos seus dados

and the time we actually started answering the questions.

e o momento em que eles realmente começaram a responder as perguntas.

How long a delay do you think we had to add

Quanto tempo vocês acham que tivemos que adicionar

in order to nullify the inhibitory effect

para anular o efeito inibitório

of knowing that faculty would see your answers?

de saber que os professores veriam suas respostas?

Ten minutes?

Dez minutos?

Five minutes?

Cinco minutos?

One minute?

Um minuto?

How about 15 seconds?

Que tal 15 segundos?

Fifteen seconds were sufficient to have the two groups

15 segundos foram suficientes para que os dois grupos

disclose the same amount of information,

expusessem a mesma quantidade de informação,

as if the second group now no longer cares

como se o segundo grupo não se importasse mais

for faculty reading their answers.

com os professores lendo suas respostas.

Now I have to admit that this talk so far

Bem, eu tenho que admitir que, até agora, essa palestra

may sound exceedingly gloomy,

pode parecer excessivamente sombria,

but that is not my point.

mas não é esse meu argumento.

In fact, I want to share with you the fact that

Na verdade, quero compartilhar com vocês o fato de que

there are alternatives.

há alternativas.

The way we are doing things now is not the only way

O jeito pelo qual estamos fazendo as coisas agora não é o único

they can done, and certainly not the best way

pelo qual elas podem ser feitas, e certamente não é o melhor

they can be done.

pelo qual podem ser feitas.

When someone tells you, "People don't care about privacy,"

Quando alguém lhe diz: "As pessoas não se importam com privacidade",

consider whether the game has been designed

pense que o jogo foi projetado

and rigged so that they cannot care about privacy,

e manipulado para que elas não possam se importar com privacidade,

and coming to the realization that these manipulations occur

e chegar à percepção de que essas manipulações ocorrem

is already halfway through the process

já é metade do caminho

of being able to protect yourself.

para ser capaz de se proteger.

When someone tells you that privacy is incompatible

Quando alguém lhe diz que a privacidade é incompatível

with the benefits of big data,

com os benefícios da big data,

consider that in the last 20 years,

considere que nos últimos 20 anos,

researchers have created technologies

pesquisadores criaram tecnologias

to allow virtually any electronic transactions

para permitir que praticamente qualquer transação eletrônica

to take place in a more privacy-preserving manner.

aconteça protegendo mais a privacidade.

We can browse the Internet anonymously.

Podemos navegar pela internet anonimamente.

We can send emails that can only be read

Podemos enviar e-mails que só podem ser lidos

by the intended recipient, not even the NSA.

pelo destinatário desejado, nem mesmo a NSA.

We can have even privacy-preserving data mining.

Podemos até ter mineração de dados preservando a privacidade.

In other words, we can have the benefits of big data

Em outras palavras, podemos ter os benefícios da big data

while protecting privacy.

e proteger a privacidade ao mesmo tempo.

Of course, these technologies imply a shifting

Claro, essas tecnologias implicam numa mudança

of cost and revenues

de custos e receitas

between data holders and data subjects,

entre os detentores dos dados e as pessoas referidas,

which is why, perhaps, you don't hear more about them.

que é o motivo, talvez, por que não se fala mais disso.

Which brings me back to the Garden of Eden.

O que me leva de volta ao Jardim do Éden.

There is a second privacy interpretation

Há uma segunda interpretação de privacidade

of the story of the Garden of Eden

da história do Jardim do Éden

which doesn't have to do with the issue

que não tem a ver com a questão

of Adam and Eve feeling naked

de Adão e Eva se sentirem nus

and feeling ashamed.

e envergonhados.

You can find echoes of this interpretation

Dá para encontrar ecos desta interpretação

in John Milton's "Paradise Lost."

no poema de John Milton, "Paraíso Perdido".

In the garden, Adam and Eve are materially content.

No jardim, Adão e Eva estão satisfeitos materialmente

They're happy. They are satisfied.

Estão felizes. Estão satisfeitos.

However, they also lack knowledge

Entretanto, eles também não têm conhecimento

and self-awareness.

e autoconsciência.

The moment they eat the aptly named

No momento em que eles comem o que é

fruit of knowledge,

chamado apropriadamente de fruta do conhecimento,

that's when they discover themselves.

é aí que eles se descobrem.

They become aware. They achieve autonomy.

Eles se tornam cientes. Eles atingem autonomia.

The price to pay, however, is leaving the garden.

O preço a se pagar, entretanto, é abandonar o jardim.

So privacy, in a way, is both the means

Então, privacidade, de certa maneira, é tanto o meio

and the price to pay for freedom.

quanto o preço a se pagar pela liberdade.

Again, marketers tell us

Novamente, marqueteiros nos dizem

that big data and social media

que big data e mídia social

are not just a paradise of profit for them,

não são somente um paraíso de lucros para eles,

but a Garden of Eden for the rest of us.

mas um Jardim do Éden para o resto de nós.

We get free content.

Nós temos conteúdo gratuito.

We get to play Angry Birds. We get targeted apps.

Podemos jogar Angry Birds. Temos aplicativos direcionados.

But in fact, in a few years, organizations

Mas na verdade, em alguns anos, organizações

will know so much about us,

saberão tanto sobre nós,

they will be able to infer our desires

que conseguirão inferir nossos desejos

before we even form them, and perhaps

antes mesmo que os tenhamos e, talvez,

buy products on our behalf

comprar produtos em nosso nome

before we even know we need them.

antes mesmo de sabermos que precisamos deles.

Now there was one English author

Bom, havia um escritor inglês

who anticipated this kind of future

que antecipou esse tipo de futuro

where we would trade away

onde ofereceríamos

our autonomy and freedom for comfort.

nossa autonomia e liberdade em troca de conforto.

Even more so than George Orwell,

Mais ainda do que George Orwell,

the author is, of course, Aldous Huxley.

o escritor é, obviamente, Aldous Huxley.

In "Brave New World," he imagines a society

Em "Admirável Mundo Novo", ele imagina uma sociedade

where technologies that we created

onde as tecnologias que criamos

originally for freedom

originalmente por liberdade

end up coercing us.

acabam nos reprimindo.

However, in the book, he also offers us a way out

Entretanto, no livro, ele também nos oferece uma saída

of that society, similar to the path

dessa sociedade, parecida com o caminho

that Adam and Eve had to follow to leave the garden.

que Adão e Eva tiveram que seguir para sair do jardim.

In the words of the Savage,

No mundo dos Selvagens,

regaining autonomy and freedom is possible,

recuperar a autonomia e a liberdade é possível,

although the price to pay is steep.

porém o preço a se pagar é alto.

So I do believe that one of the defining fights

Então eu acredito que uma das lutas que definirão

of our times will be the fight

nossa época será a luta

for the control over personal information,

pelo controle de informações pessoais,

the fight over whether big data will become a force

a luta por se big data vai se tornar um força

for freedom,

pela liberdade,

rather than a force which will hiddenly manipulate us.

em vez de uma força que vai nos manipular ocultamente.

Right now, many of us

Agora mesmo, muitos de nós

do not even know that the fight is going on,

nem mesmo sabem que a luta está acontecendo,

but it is, whether you like it or not.

mas ela está, quer vocês gostem ou não.

And at the risk of playing the serpent,

E com o risco de fazer o papel da serpente,

I will tell you that the tools for the fight

vou lhes dizer que as ferramentas para a luta

are here, the awareness of what is going on,

estão aqui, a consciência do que está acontecendo,

and in your hands,

e em suas mãos,

just a few clicks away.

só a alguns cliques de distância.

Thank you.

Obrigado.

(Applause)

(Aplausos)

Legenda Anterior

Pronunciar Palavra

Traduzir Frase Atual

Pausar / Play

Aumentar Fonte Legenda

Próxima Legenda

Pronunciar Frase

Dois Cliques para Salvar Palavra

Desativar Legenda / Ativar Legenda

Diminuir Fonte Legenda